2月16日,OpenAI宣布了*文生视频模子Sora。用户可以通过输入自然语言提醒词,天生长达1分钟的视频。Sora 也因文生视频的壮大功效而被称为“史诗级大模子”。

然而,出于公司生长战略、商业化等的多方考量,OpenAI选择了闭源Sora,甚至遮蔽了模子训练的手艺性细节。当OpenAI酿成了ClosedAI,一众大模子手艺和创业团队开启了回复Sora的设计。

“天下模拟器”的激励之下,佼佼者众。继2024年3月18日的Open Sora 1.0之后,Colossal AI再次推出了开源Sora中的尖子生——Open Sora 1.1,在开源模子的艰难复现之路上迈了一大步。

Open Sora 1.1是开源视频天生模子Open Sora 1.0的第二代,该模子支持文本到视频、图像到视频、视频到视频等多模态的功效实现,且能够举行自主视频拼接的同时保证视频内容的3D一致性。此外,Open Sora 1.1的动态分辨率也同样出彩,无需预处置便可以直接处置随便分辨率的视频。

与初代相比,该版本在功效、训练效率和整体天真性方面均有了显著提升。最显著的改善之一是能够天生长达21秒的视频,与Open-Sora 1.0 的 2 秒限制相比提升了十倍多,时间局限的大幅扩张为更普遍的创意短视频的落地打开了利便之门。

此外,新版本还大幅增添了模子巨细和数据集。与 Open-Sora 1.0版本的40万个训练视频相比,Open-Sora 1.1的训练数据集直接提升了25倍,此外,该模子自己还拥有 7 亿个参数,再搭配训练历程中对原有的STDiT架构举行了要害性改善,包罗将时序注重力中的正弦波位置编码替换为更高效的旋转位置编码,以及QK归一化手艺等的引入,保障了Open Sora 1.1半精度训练的稳固性。

10年交付11辆车,贾跃亭大概是真想回中国了

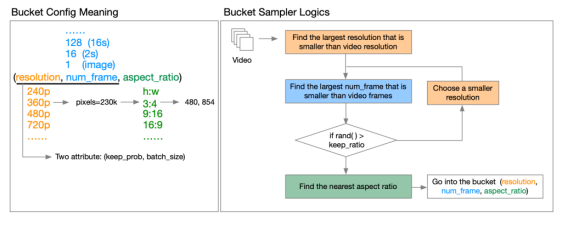

Open Sora 1.1 对 CausalVideoVAE 架构举行了优化,接纳高效多分辨率训练的Bucket系统,该系统将视频凭证分辨率、帧数和宽高比分组到Bucket中,确保具有相似属性的视频能够在统一批次内举行训练。这不仅极大地提升了在有限GPU资源上的处置效率,还通过keep_prob和batch_size等功效的引入,有用控制了盘算成本,并在训练时代实现了GPU负载的平衡。

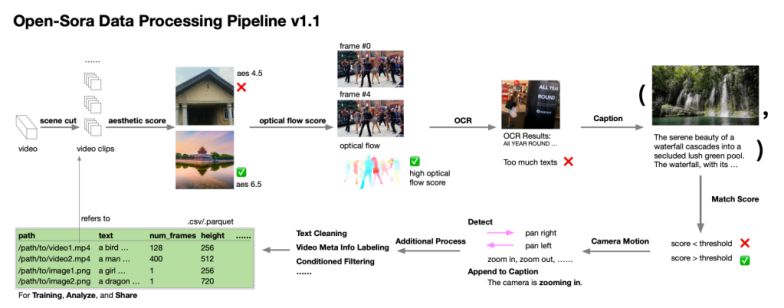

模子架构和训练之外,Open-Sora 1.1 在很洪水平上得益于细腻的数据预处置流程。行使场景检测算法首先对原始视频片断举行采样切割,从美学、光流和文本存在等方面临切割后的原始视频举行评分,在基于视觉吸引力、运动模式、语义一致性等指标对原始视频举行综合评估后,为入围的片断天生字幕,通过视频内容的文本形貌进一步厚实模子的训练数据。在此基础上举行新一轮的字幕和匹配分数盘算,筛选出字幕和视觉效果之间相关性强的训练视频,最终凭证匹配分数过滤视频片断,舍弃字幕与视频匹配度较弱的片断。

诸多buff加持下的Open-Sora 1.1成为视频处置与天生的“斜杠青年”,能够同时处置分辨率、帧长度和宽高比等种种视频属性。

但复现终究不是取代。在高仿真度还原Sora大量功效的同时,Open-Sora 1.1也存在处置庞大内容或大量token时场景还原度不高、视频可能会泛起噪声、缺乏流通度和时间一致性等问题。